Google'ın 2 MB Crawl Limiti SEO Stratejinizi Nasıl Etkiler?

3 Şubat 2026'da Google, Googlebot belgelerini güncelleyerek tarama limitlerinde değişiklik yaptı. HTML dosyaları için tarama limiti 15 MB'tan 2 MB'a düşürüldü. Açık konuşmak gerekirse günümüzde birçok site bu eşiğe ulaşmayacak olsa da bence kapsamlı bir kontrol faydalı olacaktır.

Özetle bilmemiz gereken:

- İndirme limiti: 15 MB (Googlebot'un indirdiği miktar)

- Dizine eklenme sınırı: 2 MB (Google'ın gerçekten okuyup sıraladığı miktar)

- PDF dosyalar için sınır: Hala 64 MB (değişmedi)

2 MB'ı aşan HTML sayfalar ve içerikleri, indeksleme amacıyla göz ardı edilir. Önbelleğe alınmaz ve ranking sinyalleri için taranmaz.

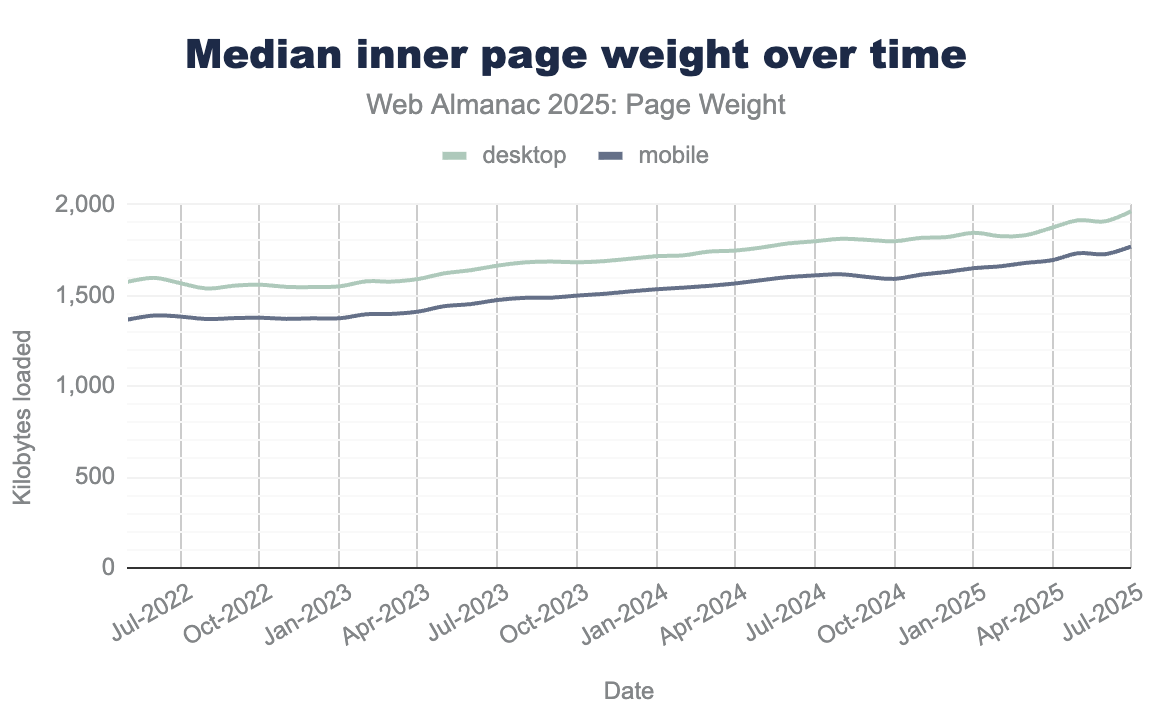

Geçtiğimiz yıla ait Httparchive verilerine göre ortalama masaüstü ana sayfası 22 KB HTML kaynağı içeriyordu. Yani Google'ın bu yeni limitine takılmak için bu sayfalarımızın neredeyse 90 kat daha ağır olması lazım; ancak sayfa ağırlıklarının genel olarak yıldan yıla arttığı da bir gerçek:

HTML Boyutunu Artırabilecek Örnekler

HTML Boyutunu Artırabilecek Örnekler

Aşağıdaki yapıların kontrolsüz uygulanması, DOM boyutunu ve render süresini artırarak performans problemlerine yol açabilir:

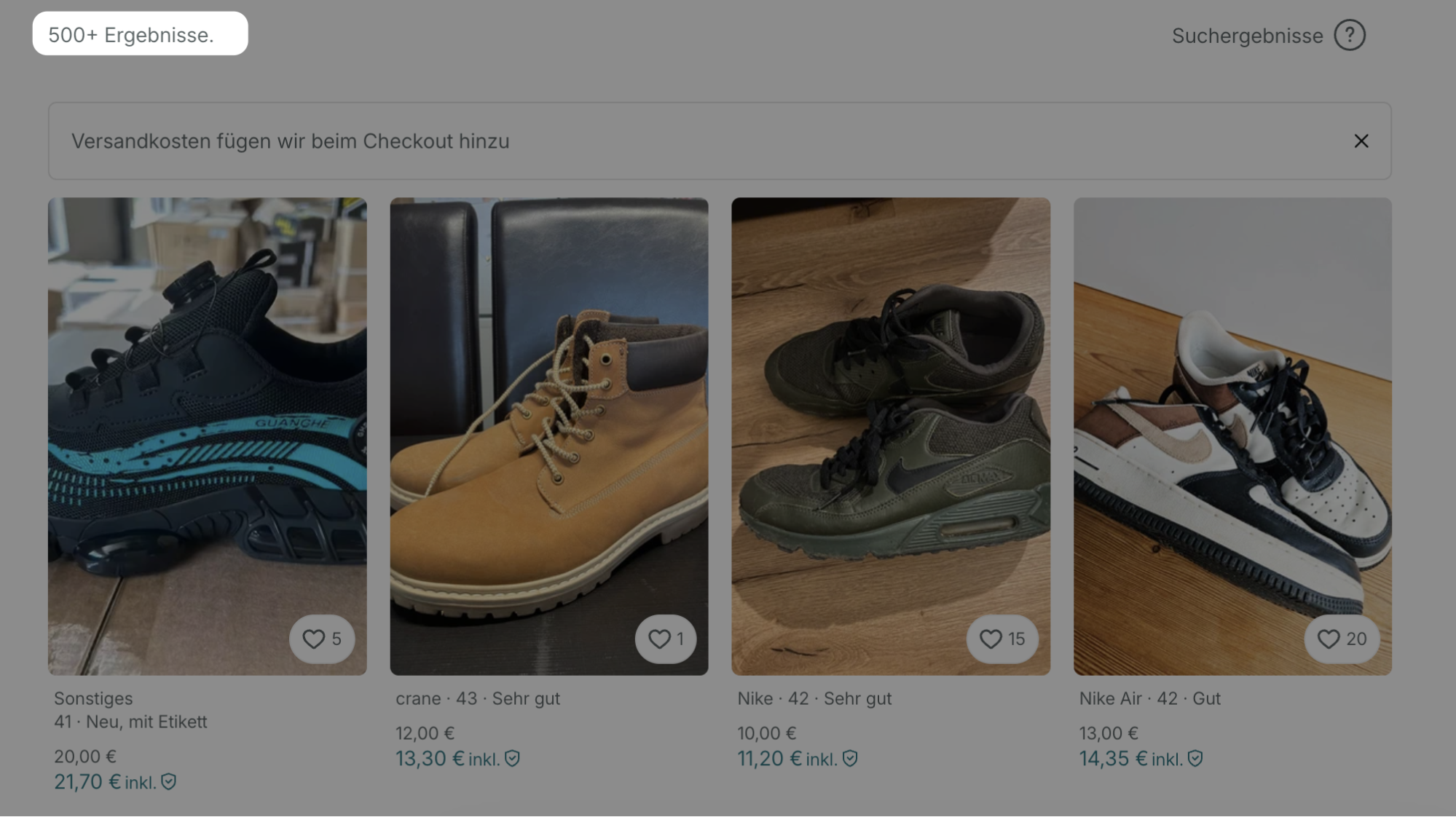

Filtreli Listeleme Sayfaları (Faceted Navigation)

Fiyat, renk, beden, özellik ve marka gibi birden fazla filtrenin seçildiği ve taranmaya açık sayfalar. Ajax yerine full HTML ile render edilen sayfaları bu kapsamda değerlendirebiliriz.

Yorumlar

Örneğin 1000+ adet yorumların tam metinlerinin yer aldığı ürün detay ya da benzer sayfalar.

Dinamik Karşılaştırma Tabloları

20+ hizmet ya da fiyatın karşılaştırılması ya da birden fazla tablonun bir arada kullanılması.

Çok Fazla Görsel Kullanımı + Lazy Load Olmayan Yapılar

Before/After galeriler, 30+ adet optimize edilmemiş görseller, inline SVG ikon setleri, Data URI görseller ve özellikle inline SVG HTML’i şişirir.

Hizmet Alanları

Lokasyon açıklamalarıyla birlikte örneğin 81 ilin çok detaylı bilgilerinini tek bir sayfada verilmesi.

Ürün Sayısı

PLP’lerde 200’den fazla ürünün listelendiği sayfalar.

Sıkça Sorulan Sorular

Sayfada 100+ FAQ olması bu sayfayı daha ağır hale getirebilir. Özellikle display:none yapıları ile gizlenen/duplicate FAQ’lar olabilir.

Yukarıdaki yapılarla sadece sayfalarda oluşabilecek ekstra yükleri özet olarak belirtmek istedim.

2 MB Tarama Limiti Nasıl Kontrol Edilir?

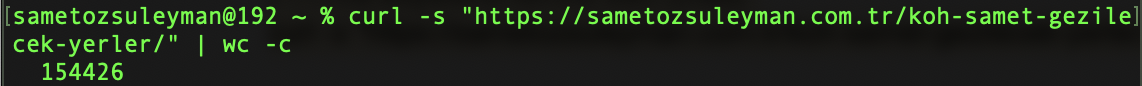

-Terminal ile hızlı bir şekilde aşağıdaki gibi kontrol sağlayabilirsiniz:

# HTML boyutunu kontrol edin (Mac)

curl -s "https://sametozsuleyman.com.tr/koh-samet-gezilecek-yerler/" | wc -c

Örnek sayfanın HTML içeriği 154.426 byte (yaklaşık 154 KB) boyutunda.

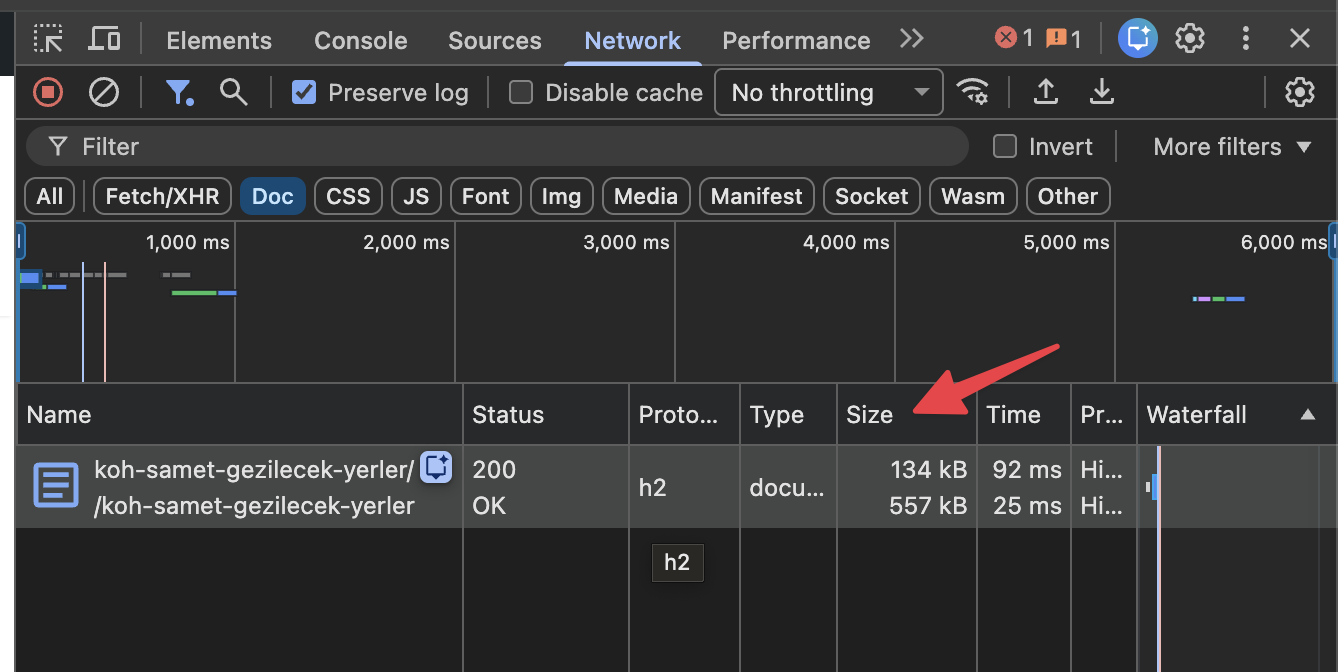

-Google Chrome ile basit bir şekilde kontrol etmek isterseniz. Network kısmında HTML sayfanızın boyutunu görebilirsiniz:

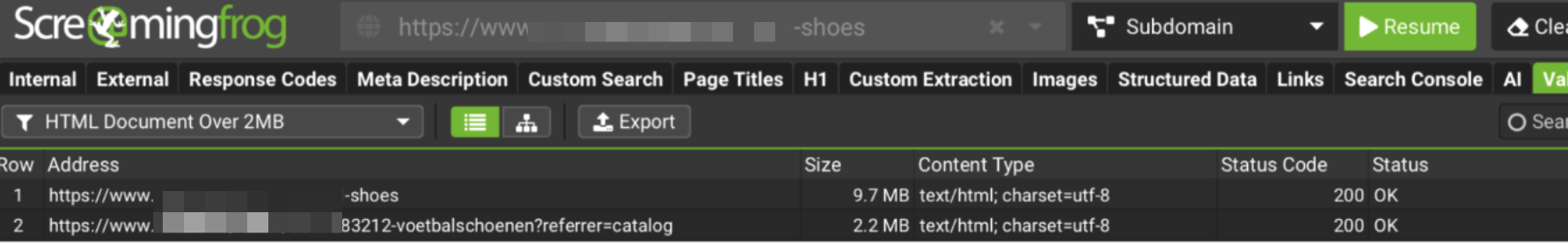

-Son olarak Screaming Frog ile Validation kısmında “HTML Document Over 2MB” kısmından tarama sonuçlarını kontrol edebilirsiniz:

Tüm bu analizlere göre 1.5 MB'ın üzerinde sonuçlar görüyorsanız, optimizasyon yapmanın ve stratejide değişiklik yapmanın sırası gelmiştir. İşte bu optimizasyonlar için bazı önerilerim:

Okumaktan yoruldunuz mu?

Bu blog yazısının, Google NotebookLM ile oluşturulmuş sesli özetini Spotify'dan da dinleyebilirsiniz.

Optimizasyon Önerileri

1) Sayfalandırma

Ürün ya da ilan listeleme sayfalarında 100+ ürün göstermek yerine bunlar için 24 ya da 48 adet olacak şekilde bir şablon belirleyin. Bu sayede HTML’deki yüzü azaltmış olacaksınız. Bu işlem sonrası Search Console ile paginated sayfalarının trafiğini de kontrol edin. Bazen page 2 ya da page 3 gibi alt sayfalar ilk sayfaya göre daha iyi pozisyon alabiliyor. Buradaki farklılıkları not edebilirsiniz. Ayrıca her ürünün ürün açıklamasını PLP’de göstermekte sayfa boyutunu artırabilir buna da dikkat edin.

2) Lazy-Load

HTML açılır açılmaz örneğin 600 yorumunuz varsa tamamını göstermeyin. İlk 10-15 tanesini yükleyin, ardından JavaScript kullanarak kullanıcı isterse daha fazla yorum getirin.

Önce: 600 yorum = ~800 KB HTML

Sonra: 10 yorum + lazy load = ~50 KB HTML

3) SSS Sayfalarına Ayırın

200 soruluk FAQ kullanmak yerine bu soruları konu kümelerine ayırabilir ve benzer soruları birleştirebilirsiniz. GEO çalışmaları kapsamında bazen dikkat edilmeden çok fazla sorular sayfalara ekleniyor; ama işin teknik SEO kısmı göz ardı edilebiliyor. Başka bir kullanım olarakta soruların sayılarını azaltamıyorsanız /faq/fiyat/ ya da /faq/iade-teslimat/ gibi ayrı URL’lerde bu soruları cevaplamayı düşünebilirsiniz.

Ayrıca 81 şehri listeleyen tek bir sayfa yerine her lokasyona ait sayfalar oluşturmayı planlayabilirsiniz. …/sehirler/samsun gibi URL’lerden bunları yayınlayabilirsiniz.

4) Yorumlar

HTML'de toplam yorum sayısını ve ortalama puanı gösterin ve bunu varsa varyant schema ile desteklemeyi unutmayın; ancak sayfada binlerce yorumu tamamen yüklemeyin. Sayfa yüklendikten sonra JavaScript ile yorumların tam metnini yüklenmesini sağlayın.

<!-- Initial HTML -->

<div class="movie-summary">

<span>Inception (2010) - ⭐ 8.8</span>

<button id="load-details">Detayları Göster</button>

</div>

<!-- Film detayları -->

<div id="movie-details"></div>

2 MB Limiti Üstünde Sayfalar Varsa Ne Olur?

Kontrolleriniz sonucunda 2 MB'ın üzerinde HTML sayfalarınız varsa :

- Google bu limitin üstündeki dikkate almayacaktır.

- Sayfa içinde çok aşağıdaki satırlarda kalan iç bağlantılar, schema kodları veya diğer önemli elementleri Googlebot’a gösteremiyeceksiniz.

- Sayfadaki önemli diyebileceğimiz içerikler belki de limite takıldığı için dizine eklenemeyecek.

Aksiyon olarak hemen yukarıda ilettiğim örnek kontrollerinizi gerçekleştirin. Siteniz çok büyük ise ve tarama yapmak için yeterli bir bütçeniz yoksa sizin için çok değerli top 100 sayfanızı kontrol edin. Nereyi optimize edeceğinize karar verip buna göre Dev ekipleri ile iletişime geçebilirsiniz.

Özet olarak aslında konumuz yine Core Web Vitals optimizasyonuna çıkıyor. Daha hızlı yükleme süreleri kullanıcı deneyimine olumlu katkı sağlayıp 2 MB gibi limitlere takılmamanızı sağlayacaktır. Siz sayfalarınızı ne kadar iyi optimize ederseniz edin bu tür yeniliklerden çok korkmanıza gerek kalmayacaktır. Buraya kadar yazıyı okuyup aksiyon almak için harekete geçen herkese çok teşekkürler!